港科大版图像分割AI“Semantic-SAM”来了 比Meta「分割一切AI」更全能

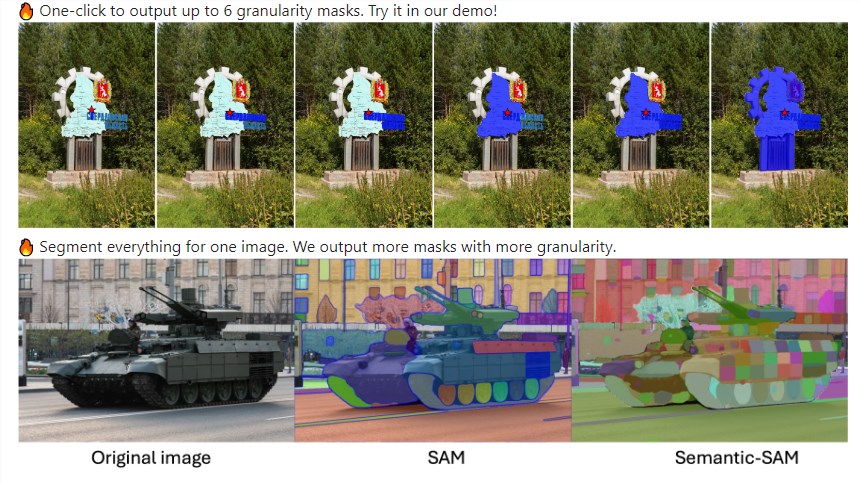

香港科技大学团队开宣布一款名为 Semantic-SAM 的图画切割 AI 模型,比较 Meta 的 SAM 模型,Semantic-SAM 具有更强的粒度和语义功用。该模型可以在不同粒度级别上切割和辨认物体,并为切割出的实体供给语义标签。

研讨团队经过联合练习 SA-1B 数据集、通用切割数据集和部件切割数据集,完成了多粒度切割使命和交互切割使命的优化。Semantic-SAM 根据 Mask DINO 结构进行开发,其模型结构首要改进在 decoder 部分,一起支撑通用切割和交互式切割。

模型的练习过程中,选用解耦的物体分类和部件分类办法,以学习物体和部件的语义信息。试验结果表明,Semantic-SAM 在切割质量和粒度可控性方面优于 SAM 模型。总归,Semantic-SAM 是一款全面且强壮的图画切割 AI 模型。

来历:

站长之家